Hopfield与Hinton如何通过人工神经网络改变科技,推动深度学习的革命。

如果你在观看最新的人工智能生成视频时目瞪口呆,或是通过反欺诈系统保护了银行账户,又或者在匆忙中能够语音发送信息,那么你要感谢众多科学家、数学家和工程师。

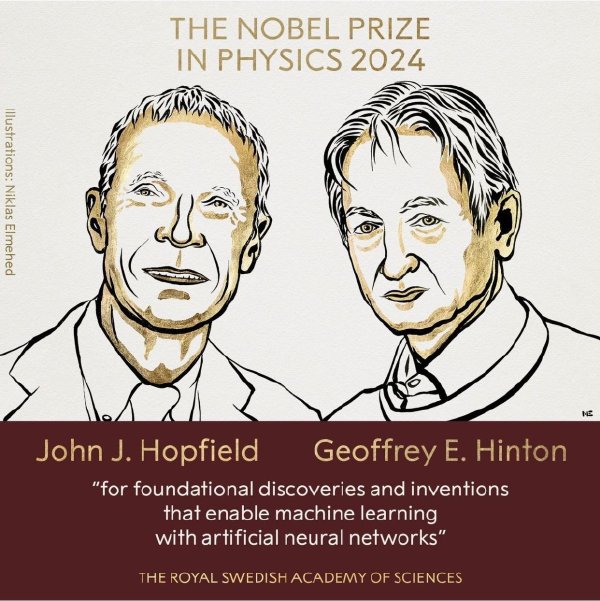

但John Hopfield和Geoffrey Hinton这两个名字在深度学习技术的发展中尤为突出。他们的贡献使这些体验成为可能。

2024年10月8日,这两位研究者因在人工神经网络领域的开创性工作获得诺贝尔物理学奖。尽管人工神经网络是模仿生物神经网络,但他们的研究也基于统计物理,因此获得了物理学奖。

神经元的计算方式

人工神经网络起源于对生物神经元的研究。1943年,神经生理学家Warren McCulloch和逻辑学家Walter Pitts提出了神经元工作的简单模型。

在McCulloch-Pitts模型中,神经元与邻近神经元相连,可以接收来自它们的信号,然后将这些信号结合后发送给其他神经元。

有个特别之处在于,神经元对来自不同邻居的信号的权重可以不同。例如,你想决定是否购买一款热销手机,向朋友咨询推荐。

一个简单的策略是收集朋友的推荐,根据大多数人的意见来决定。如果你问了三位朋友:艾丽斯、鲍勃和查理,他们分别给出了“赞同”、“赞同”和“反对”的意见。你会因此决定购买这款手机,因为有两个赞同和一个反对。

但是,如果你对某些朋友的技术知识更有信任,可能会更重视他们的意见。假设查理非常懂行,你可能会把他的反对意见算作三次,这样你的决定就变成不买手机——两个赞同和三个反对。

如果你有一个完全不信任的朋友,你甚至可以给他们的意见分配负权重,这样他们的赞同就变成反对,反对变成赞同。

一旦你做出决定,其他朋友就可以向你询问推荐。

同样,在人工和生物神经网络中,神经元可以聚合邻居的信号,并向其他神经元发送信号。

这就引出了一个关键的区别:网络中是否存在循环?例如,如果我今天问艾丽斯、鲍勃和查理,明天艾丽斯问我推荐,那么就形成了一个循环:从艾丽斯到我,再回到艾丽斯。

如果神经元之间的连接没有循环,计算机科学家称之为前馈神经网络,神经元可以分层排列。第一层是输入,第二层接收来自第一层的信号,依此类推,最后一层代表网络的输出。

然而,如果网络中存在循环,计算机科学家称之为递归神经网络,神经元的排列会比前馈神经网络更复杂。

Hopfield网络

人工神经网络的初步灵感来自生物学,但很快其他领域也开始影响其发展,包括逻辑、数学和物理学。

物理学家约翰·Hopfield利用物理学的理念研究了一种特定的递归神经网络,现称为Hopfield网络。他特别关注这些网络的动态:随时间变化会发生什么?

这种动态在信息通过社交网络传播时也很重要。众人皆知,网络上的热门话题和回音室现象都是基于人们之间简单信息交换的集体现象。

Hopfield是利用物理模型(特别是研究磁性时发展出的模型)来理解递归神经网络动态的先驱。他还表明,这些动态可以赋予神经网络一种记忆。

Boltzmann机与反向传播

在1980年代,Geoffrey Hinton、计算神经生物学家Terrence Sejnowski等人扩展了Hopfield的理念,创造了一类新的模型,称为Boltzmann机,以19世纪物理学家Ludwig Boltzmann命名。

顾名思义,这些模型的设计根植于Boltzmann开创的统计物理。

与Hopfield网络可以存储模式并纠正错误不同,Boltzmann机能够生成新模式,从而为现代生成性人工智能革命播下了种子。

Hinton还参与了1980年代的另一个突破:反向传播。如果你希望人工神经网络执行有趣的任务,必须选择合适的权重来连接人工神经元。

反向传播是一种关键算法,使根据网络在训练数据集上的表现选择权重成为可能。然而,训练多层人工神经网络仍然具有挑战性。

在2000年代,Hinton和他的同事巧妙地使用Boltzmann机逐层预训练多层网络,然后在预训练网络上使用另一种微调算法进一步调整权重。

多层网络被重新命名为深度网络,深度学习革命由此开始。

人工智能对物理学的回报

诺贝尔物理学奖表明,物理学的理念推动了深度学习的发展。如今,深度学习开始回馈物理学,使得从分子、材料到整个地球气候的系统能进行准确而快速的模拟。

授予Hopfield和Hinton诺贝尔物理学奖,奖委会希望人类能利用这些进步促进人类福祉,建设可持续的世界。

本文译自 ScienceAlert,由 BALI 编辑发布。