OpenAI发布了具备思考能力的ChatGPT Images 2.0模型。该模型显著提升了文字渲染、物体放置及多图生成的一致性,支持中文等多种非拉丁语系文字。

分辨一张图片是人类创作还是人工智能生成的通常非常简单。就在2年前,如果你尝试让图像模型制作一份餐厅菜单,它可能会生造出一些莫须有的菜名。但现在,这一切都发生了翻天覆地的变化。

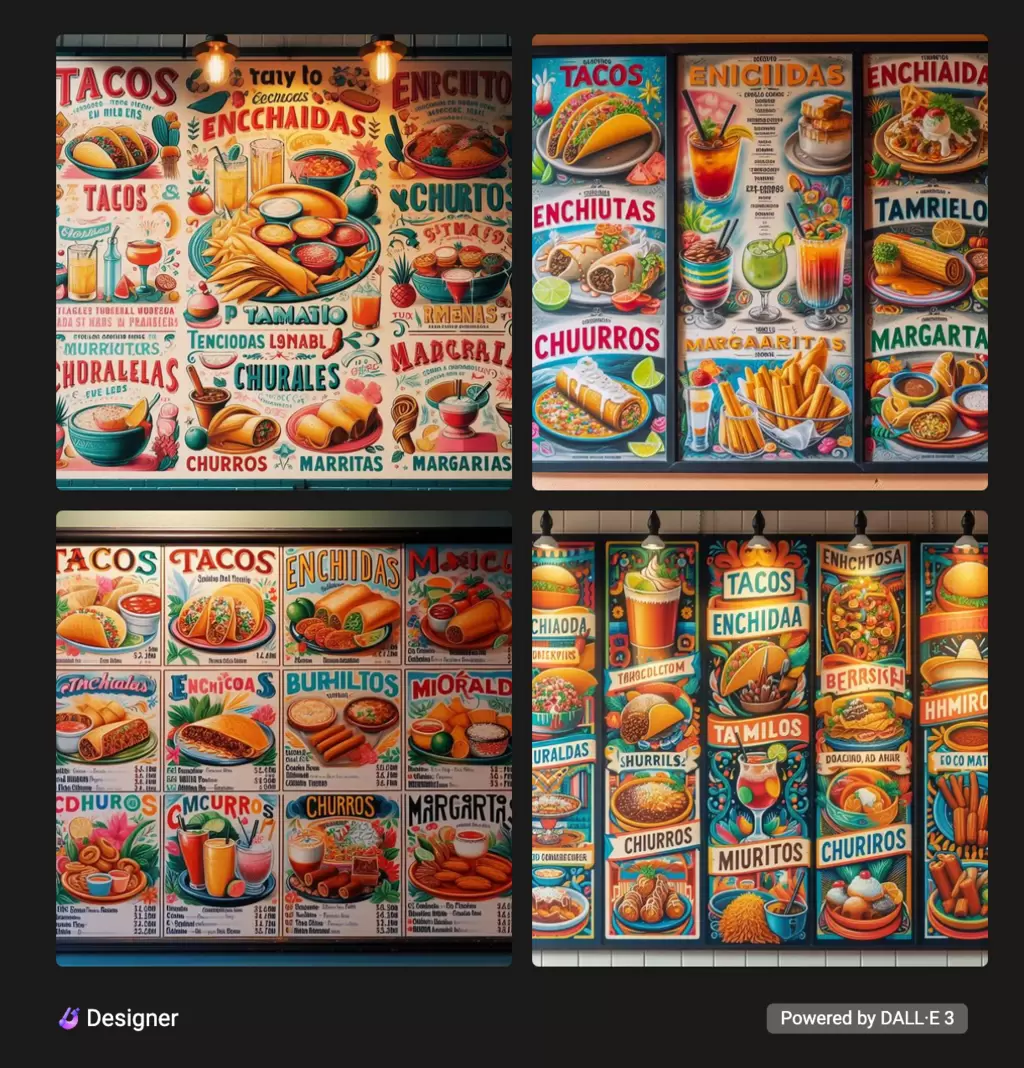

OpenAI本周正式推出了ChatGPT Images 2.0模型。这个新一代系统最显著的进步在于,它不仅能画图,还开始学会了思考。与以往的模型不同,Images 2.0具备了推理能力,可以在生成图像之前搜索网页信息,甚至能对自己的作品进行自检。这种视觉思维的引入,让它在处理复杂任务时表现得更加得心应手。在实际测试中,当要求它制作一份墨西哥菜菜单时,生成的文字已经达到了可以直接在餐厅使用的水平,甚至能根据网页信息准确标注出13.50美元这样的价格。

ChatGPT Images 2.0生成的墨西哥菜菜单

这是两年前DALL-E 3的生图水平,当时ChatGPT还没有生图模型

对于用户来说,最直观的感受莫过于它终于能正确地渲染文字了。以往AI画图最怕文字,常常会出现扭曲的乱码。而Images 2.0现在可以精确地在图片中生成细小的字体、用户界面元素和各种标志。更令人惊喜的是,它打破了拉丁字母的局限,现在可以自如地处理中文、日语、韩语、印地语和孟加拉语等多种非拉丁语系的文字。无论是一本带有印地语标题的书籍封面,还是一张带有精准中文说明的宣传单,它都能交出精准的答卷。

在构图和细节还原上,这个新模型也实现了跨越。它可以处理包含多个物体及其复杂关系的精密提示词。比如,你可以要求它生成一组漫画,它能在一组提示词下同时生成多张图片,并保持角色、字体、色调和整体氛围的高度一致。这对于社交媒体运营或创意设计团队来说无疑是一个极大的助力。用户可以一次性要求生成最多8张图片,且支持3:1或1:3等多种极端的高宽比。

此外,Images 2.0在写实主义方面也取得了长足进步。它可以生成肤色和特征极其真实的各类人物,并能根据提示词准确还原不同时代背景下的环境细节。无论你是需要像素艺术、透明背景的PNG图片,还是分辨率高达2K的精美海报,它都能胜任。需要注意的是,该模型的知识储备截止到2025年12月,这可能会影响它处理涉及最新新闻的提示词。

目前,所有的ChatGPT和Codex用户都已经可以开始体验这个新模型。不过,为了区分服务等级,OpenAI将更高级的思考模式和更高质量的输出保留给了付费订阅用户。开发者也可以通过gpt-image-2接口获取这些能力,计费方式将取决于输出的质量和分辨率。

这一发布时机也显得颇有深意。就在几天前,人类学公司刚刚推出了自己的设计助手。面对来自谷歌公司和中途公司等竞争对手的压力,OpenAI显然希望通过Images 2.0在文字处理、多语言支持和逻辑推理方面的优势,继续巩固其在AI图像生成领域的领先地位。随着图像模型开始拥有类似大语言模型的预测和推理能力,这些技术也将为其未来构建复杂的广告平台打下基础。尽管生成一张复杂的漫画可能需要几分钟时间,但这种高保真度和对细节的掌控力已经让它在同类产品中脱颖而出。

本文译自 Techcrunch,由 BALI 编辑发布。