可在消费级硬件上快速生图的AI模型

sein @ 2024.12.12 , 04:16 下午英国萨里大学“以人为本人工智能研究所”(PAI)宣布推出一款名为NitroFusion的开创性AI模型。这款模型可以通过用户输入即时生成图像,仅需普通消费者级别的硬件支持,改变了AI图像生成技术的可及性。

由PAI旗下SketchX实验室开发并开源的NitroFusion,是全球首个此类技术,旨在为创意行业的专业人士提供便捷高效的AI图像生成工具。

“NitroFusion消除了大多数图像生成平台所需的大量计算资源和长时间等待,标志着AI技术普及的转折点。”

——萨里大学以人为本人工智能研究所联合主任、人工智能硕士项目负责人Yi-Zhe Song教授

与以往需要强大计算能力的技术不同,NitroFusion仅需一张普通消费者级显卡即可运行。这一突破让个人创作者、小型工作室和教育机构能够负担得起先进的AI能力,同时实现了即时图像生成,使得艺术创作更加高效和可控。

“NitroFusion采用了一种动态对抗框架,类似一组专业艺术评论家对生成图像进行多方面评估,确保图像质量一步到位。用户还可以选择1至4步优化过程,平衡生成速度与图像质量。”

——项目开发成员、PAI博士研究员Dar-Yen Chen

继去年发布DemoFusion(用于提升AI生成图像的分辨率)后,这次创新再次巩固了萨里大学在普及AI技术领域的领先地位。

NitroFusion的主要优势包括:

* 即时图像生成:随着用户输入文字即时响应,为创意迭代和实验带来更多可能;

* 环保与可持续:显著降低能源消耗;

* 硬件门槛低:仅需一张高性能GPU即可运行,适合个人和小型工作室;

* 完全开源:促进全球创新和多样化发展;

* 无需云服务或订阅费用:降低使用成本,提升技术普及度。

“我们相信,这在全球范围内是首次在如此规模和效率下实现交互式图像生成。NitroFusion不仅是技术的突破,也是我们让创造性AI工具触手可及的承诺。”

——萨里大学以人为本人工智能研究所主任、视觉、语音与信号处理中心主任Adrian Hilton教授

NitroFusion现已上线,用户可通过官方网站获取技术资源和社区支持,同时可在Arxiv上查阅技术论文。

本文译自 University of Surrey,由 sein 编辑发布。

# sein:以上是介绍原文,有没有那么好一试便知

github主页:https://github.com/ChenDarYen/NitroFusion

huggingface可下模型:https://huggingface.co/ChenDY/NitroFusion

既然是个1 step模型,我下载了nitrosd-realism、nitrosd-vibrant这两个unet模型文件,在comfyUI简单组个workflow测试,step设置为1。结果CLIP编码过不了,KSampler节点反复报错:mat1 and mat2 shapes cannot be multiplied

这种独家模型都不兼容常规CLIP和VAE,就只能试试它给的在线测试了:https://huggingface.co/spaces/ChenDY/NitroFusion_1step_T2I

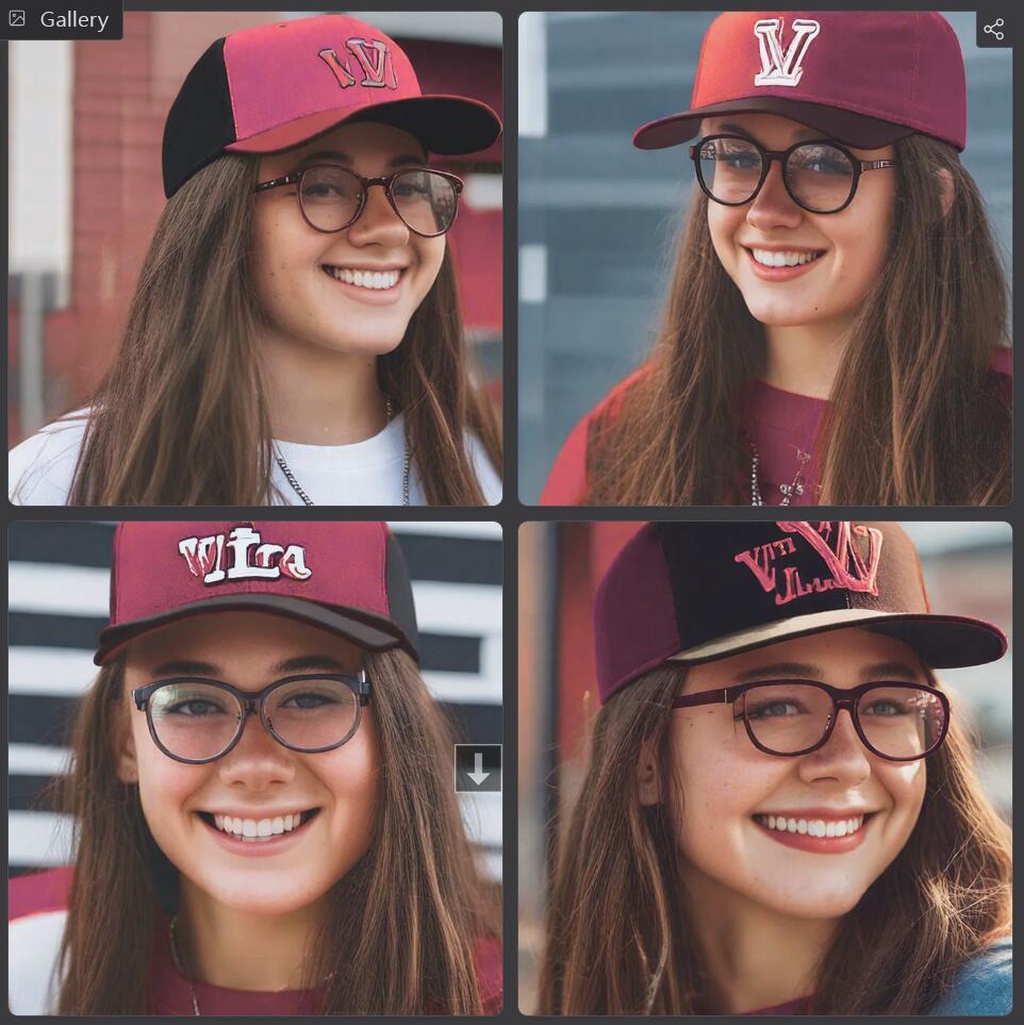

默认的猫看起来还行,但我测试复杂点的prompt就怪怪的了:

对比下sd35 medium用同样prompt的出图:

可以理解为炫技之作,如果有第三方微调和优化应该还行。

事实上什么8步出图、4步出图甚至1步出图的大模型也有不少,但都是“又不是不能用”的水平。真正在快速出图上特别使用的,还是字节出的Hyper-SD系列Lora,真的又快又好,推荐大家试试:https://zhuanlan.zhihu.com/p/717133834

PREV : 不会说西班牙语的西班牙语拼字比赛冠军

NEXT : 当我们80岁了还能保持希望与幸福吗